Quanto diventerà pericolosa l'AI? I tre scenari peggiori

Migliaia di esperti hanno chiesto lo stop immediato dello sviluppo dell'intelligenza artificiale. Questa paura è giustificata?

Migliaia di esperti hanno chiesto lo stop immediato dello sviluppo dell'intelligenza artificiale. Questa paura è giustificata?

ZURIGO - Circa un migliaio di esperti di tecnologia, tra cui il CEO di Tesla Elon Musk, hanno redatto una lettera che mette in guardia dall'intelligenza artificiale (AI).

Queste le dichiarazioni più importanti contenute nella lettera aperta pubblicata su Futureoflife.org:

- Gli sviluppatori d'intelligenza artificiale sono impegnati in una corsa fuori controllo.

- Nemmeno gli sviluppatori capiscono appieno le AI.

- Neanche gli sviluppatori possono prevedere il comportamento delle AI.

- Le AI rappresentano quindi un rischio molto grande per le persone e la società.

La lettera solleva diversi interrogativi: «Dovremmo lasciare che le macchine inondino i nostri canali d'informazione con della propaganda? Dovremmo automatizzare tutte le professioni, anche quelle appaganti? Dovremmo sviluppare intelligenze che possano sostituirci? Dovremmo davvero rischiare di perdere il controllo della nostra civiltà?».

L'autorità di polizia europea Europol ha recentemente espresso i suoi timori riguardo le AI, così come ha fatto anche il Consiglio etico tedesco.

Esplosione dell'intelligenza nelle macchine

Anche il fisico Stephen Hawking, considerato una delle persone più intelligenti al mondo, aveva avanzato preoccupazioni riguardo le AI, sottolineando come l'intelligenza artificiale sia estremamente brava a raggiungere i suoi obiettivi. «E quando questi non sono in linea con i nostri... abbiamo un problema», aveva dichiarato. Hawking ha anche messo in guardia dall'«esplosione dell'intelligenza nelle macchine» affermando che le AI possono diventare più intelligenti dei loro creatori.

Si sente sempre più spesso parlare di tre possibili scenari: disoccupazione di massa, disordini sociali e una macchina modello "Terminator" che schiavizza l'umanità e la fa sprofondare nel caos.

Ma sono previsioni realistiche? Facciamo un po' di chiarezza interpellando degli esperti.

Scenario 1: l'intelligenza artificiale fa precipitare l'umanità nel caos

Il primo paragrafo della lettera aperta spiega: «I sistemi d'intelligenza artificiale pongono seri rischi per la società e l'umanità». Ecco perché vengono chiesti sei mesi di pausa fino a quando la sicurezza non sarà garantita. Ma che aspetto ha effettivamente lo scenario peggiore? Possiamo aspettarci un futuro simile a quello presentato da film cult come "Terminator" o "iRobot", dove le macchine dominano l'umanità?

Ecco come l'AI di ChatGPT potrebbe in realtà evolversi: nessun robot da combattimento, ma piuttosto un'infrastruttura «in grado di assumere il controllo di sistemi importanti come l'approvvigionamento energetico, i sistemi finanziari, i trasporti e le comunicazioni». Tutto ciò porterebbe a «caos e distruzione».

Tali scenari sono comunque molto improbabili e basati sulla fantascienza. Tuttavia, le preoccupazioni degli esperti non vanno prese alla leggera. Ne è convinto Thilo Stadelmann, professore al Centro per l'intelligenza artificiale della ZHAW: «I timori riguardo alle conseguenze sociali sono giustificati, anche se le previsioni più terribili sono pura fantasia».

Lo scenario horror alla Terminator è attualmente irrealizzabile a livello tecnologico. «Non esiste ancora un'intelligenza autonoma. Ci vorranno sicuramente altri 15 anni prima che si possa parlare di situazioni come questa», afferma l'esperto.

Il fatto che Future of Life abbia pubblicato una lettera aperta firmata da giganti della tecnologia come Musk and Co. è per Stadelmann una trovata pubblicitaria: «È stato fatto per attirare l'attenzione», spiega. Secondo l'esperto, dietro ci sono principalmente interessi personali ed economici. Un arresto dello sviluppo di queste AI potrebbe avvantaggiare imprenditori come Elon Musk.

Scenario 2: l'intelligenza artificiale scatena un'ondata di fake news

«Lo scenario peggiore si avvererebbe se l'intelligenza artificiale sviluppasse una vita propria e diventasse manipolativa, permettendo di conseguenza d'influenzare la società», sottolinea Andre Wolf, portavoce di Mimikama, un'associazione per la sensibilizzazione sugli abusi di Internet. Gli strumenti d'intelligenza artificiale fanno già parte di campagne di disinformazione di massa. «Finora, tuttavia, non abbiamo notato un aumento delle segnalazioni a causa di questo fenomeno», aggiunge Wolf.

Di recente hanno suscitato scalpore le immagini del Papa con addosso un soffice piumino o di Donald Trump arrestato. Questi scatti, seppure molto realistici, sono stati generati con l'intelligenza artificiale. Quindi l'AI ha il potere di dividere la società? «Funziona sempre, attraverso qualsiasi forma di disinformazione». È qui che entra in gioco il cosiddetto "bias di conferma": «Se presumo già che Donald Trump sia stato arrestato, e poi vedo la foto, penso: "Ah, avevo ragione"'».

Proprio per questo l'utenza dovrebbe essere formata di conseguenza. Secondo l'esperto, inoltre, dovrebbero essere applicate regole chiare. «Abbiamo delle leggi. Anche l'intelligenza artificiale dovrebbe aderirvi. E se viene commessa un'infrazione qualcuno deve essere giudicato e perseguito».

Scenario 3: l'intelligenza artificiale porta alla disoccupazione di massa

Le aziende continuano a sostenere da anni che l'intelligenza artificiale crei più posti di lavoro di quanti ne distrugga. Tuttavia, sempre più persone temono che le AI li renderanno disoccupati.

Uno studio di Goldman Sachs suggerisce che i timori per il lavoro non sono infondati: le AI potrebbero sostituire 300 milioni di dipendenti in tutto il mondo. Secondo la banca statunitense sono particolarmente colpiti settori quali la logistica, la produzione, il lavoro d'ufficio e amministrativo. L'automazione interessa circa il 16% dei posti di lavoro globali.

Le AI sono così efficienti da rendere necessarie meno persone per lo stesso lavoro, concorda Thilo Stadelmann del Centro per l'intelligenza artificiale della ZHAW. Particolarmente colpiti sono i posti di lavoro nei seguenti settori:

- informatica

- assemblaggio e produzione

- assistenza sanitaria

- banca e finanza

- trasporti e logistica

- assistenza clienti

- commercio al dettaglio e all'ingrosso

- educazione e pedagogia

- pubblicità e marketing

- legge

Tuttavia, il "fattore umano" continuerebbe a dominare il mondo professionale, rassicura la consulente aziendale Dorothea Baur. Il supporto umano, infatti, è ancora necessario, soprattutto quando si tratta di decisioni molto delicate. «Le persone non dovranno semplicemente trasformarsi in babysitter dell'intelligenza artificiale: è ancora necessario un impegno significativo dell'uomo».

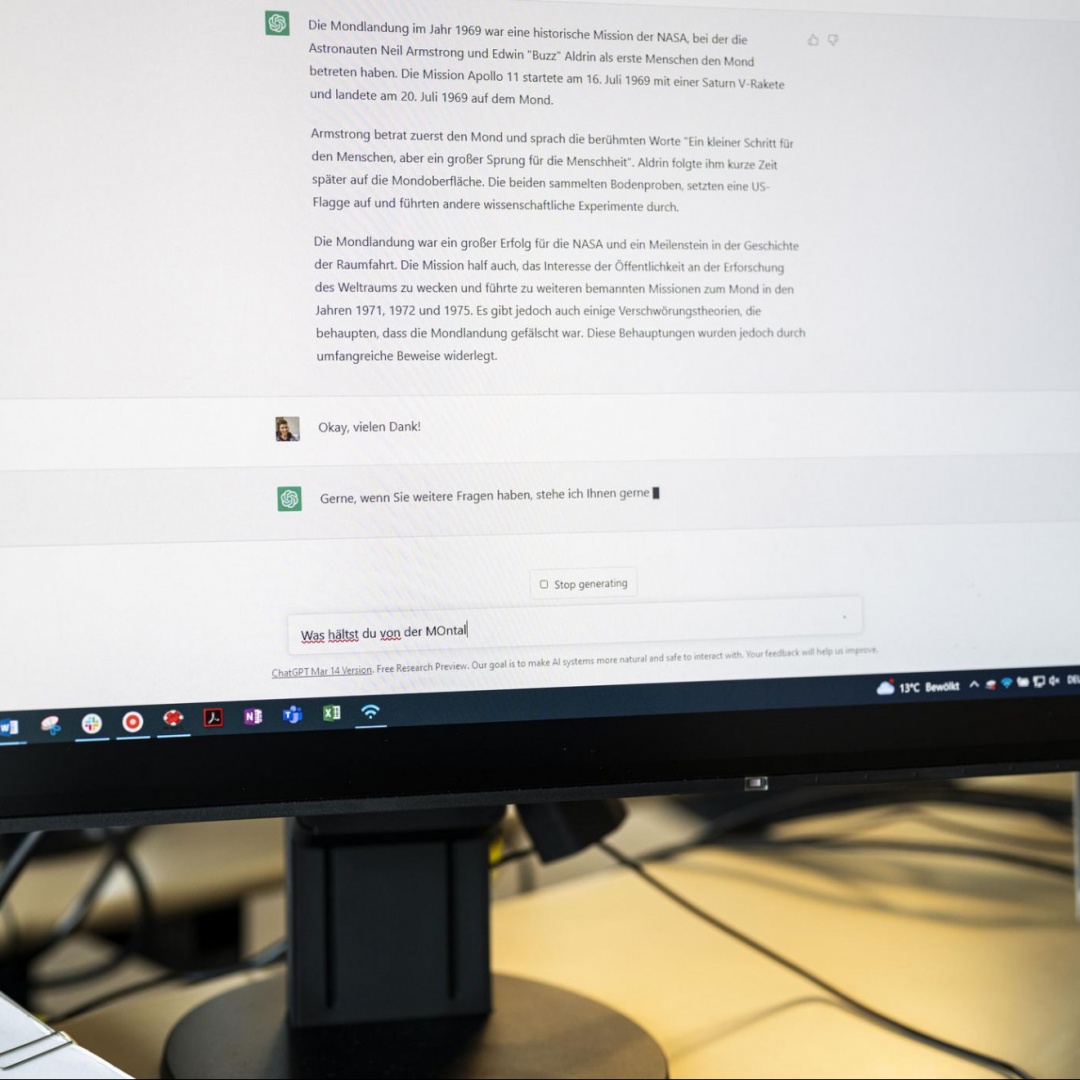

Questo è ciò che ChatGPT-4 dice sull'argomento

Sei un pericolo per l'umanità?

ChatGPT-4: Film come "Terminator" hanno contribuito ad alimentare i timori sull'intelligenza artificiale. Tuttavia, tali scenari sono lontani dalla realtà. Perché come intelligenza artificiale, sono uno strumento sviluppato e controllato dagli umani. Sono un programma per computer e non ho intenzioni, desideri o emozioni mie.

Cosa ne pensi al riguardo?

Una moratoria sullo sviluppo dell'AI può aiutare a creare protocolli di sicurezza, linee guida etiche e regolamenti. Ma una moratoria potrebbe anche rallentare i progressi. Paesi o aziende che optano per una moratoria potrebbero restare indietro.

Se lo sviluppo continua senza sosta, dove sarà l'AI tra cinque anni?

Difficile fare previsioni precise. Possibili sviluppi: conversazione umana e sistemi d'intelligenza artificiale per robot. E potrebbero esserci progressi nell'AI in generale, con sistemi in grado di svolgere un'ampia gamma di compiti.

Tutte le risposte provengono da ChatGPT-4.