Il fenomeno deepfake, che “incolla” i visi sui corpi nudi delle clip osé è sempre più diffuso. Le vittime parlano di «stupro sociale»

Helen Mort è una rinomata poetessa e scrittrice britannica che, nel 2020, ha scoperto di essere protagonista di un video pornografico. Un cortocircuito tra la sua vita reale, e ciò che sembrava reale ma non era la sua vita, che le ha causato numerosi problemi, pratici e psicologici. La scrittrice ha deciso di raccontare la sua drammatica vicenda sul quotidiano britannico Guardian che ha realizzato un reportage dal titolo 'My Blonde GF' (la mia ragazza bionda, ndr.)

La Mort racconta di aver appreso di essere protagonista di alcuni video pornografici da un suo amico e di essere rimasta scioccata e incapace di dire altro che «è impossibile» o «cosa ho fatto per meritarlo?».

«Alcune immagini-racconta la donna-erano come grotteschi lavori di Photoshop, falsi evidenti. Altre che raffiguravano il sesso violento erano più plausibili. Tutte erano profondamente inquietanti».

La scrittrice racconta di essere rimasta come intorpidita davanti a tale tipo di immagini create, senza dubbio, alterando delle immagini ordinarie pubblicate sul web per creare contenuti pornografici. Quanto accaduto ha avuto sulla Mort un impatto devastante e «anche andare a prendere mio figlio all'asilo era diventato un calvario». Essere, a propria insaputa e del tutto falsamente, protagonista di video pornografici aveva reso la scrittrice molto vulnerabile al giudizio altrui, come se tutti sapessero «e potessero conoscere il mio segreto».

Deposit

DepositUn (altro) lato oscuro della AI

La scrittrice è dovuta andare in terapia, per liberarsi dai suoi incubi, e se ha ricevuto tanti attestati di solidarietà non sono però mancati anche i detrattori. I commenti lesivi sono stati tanti e qualcuno è arrivato a chiederle che differenza ci fosse tra un dipinto che la ritrae nuda, considerato lusinghiero, e dei filmati pornografici.

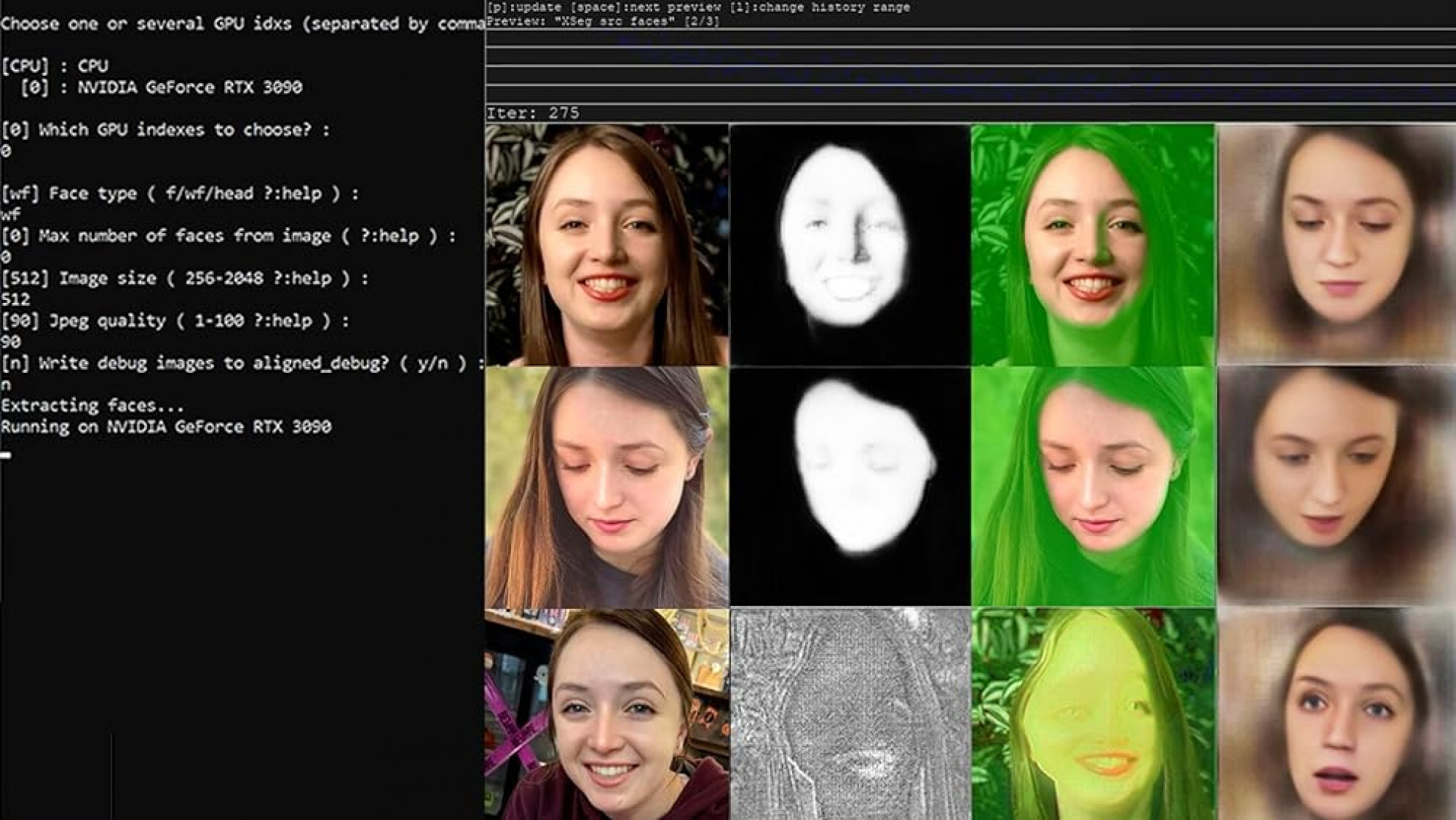

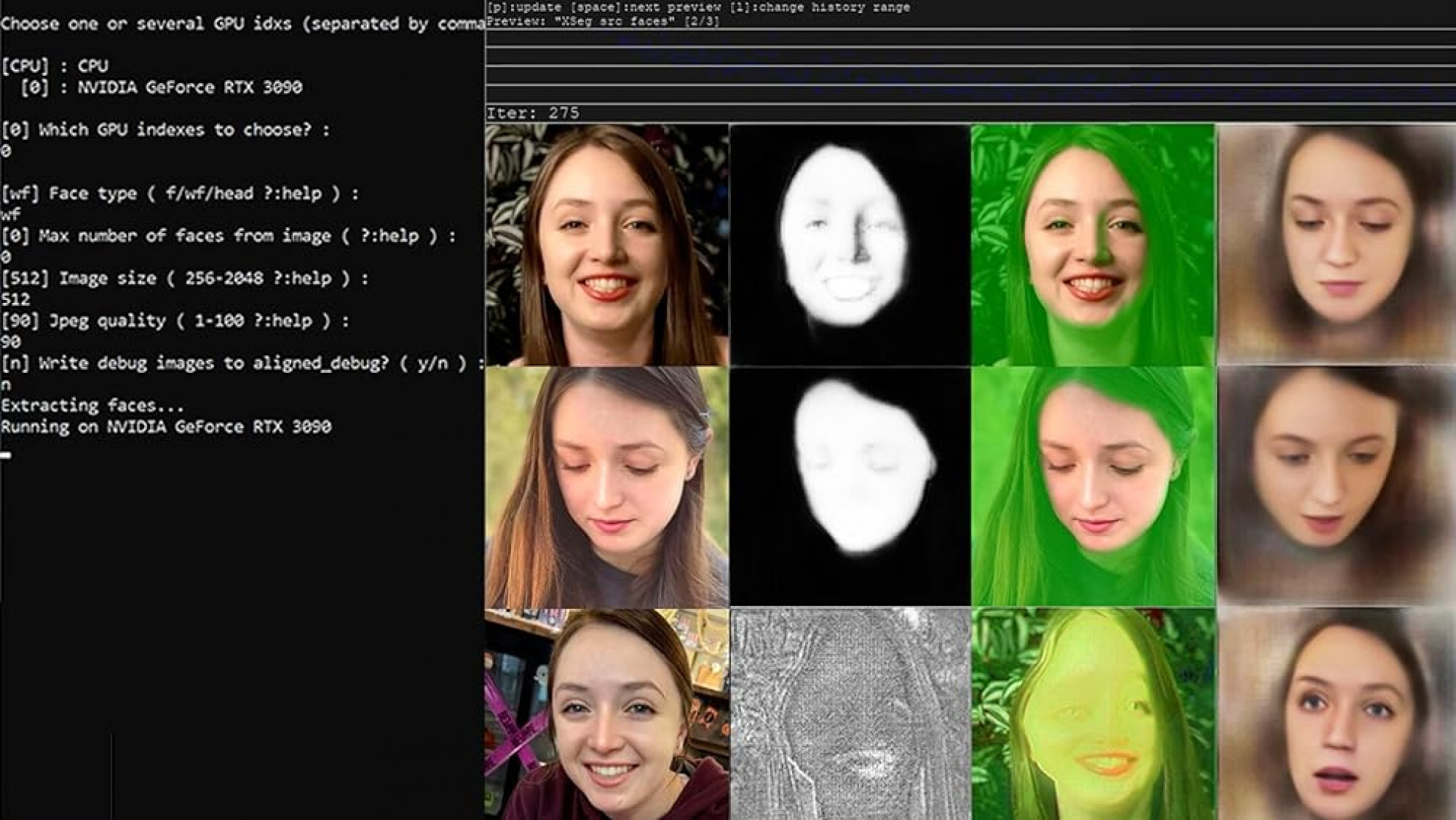

Quanto accaduto da Helen Mort è un classico caso di deepfake, una tecnica per la sintesi dell'immagine umana, basata sull'Intelligenza Artificiale, che partendo da immagini o file audio reali riesce ad creare, in modo estremamente realistico, contenuti diversi dall'originale. Il fenomeno (di cui avevamo già approfondito i diversi aspetti) è in costante crescita e il suo utilizzo è spesso associato alla creazione di contenuti lesivi per la dignità di coloro la cui immagine viene utilizzata per crearne un'altra falsa.

Da quando i deepfake hanno fatto il loro ingresso nel mondo della tecnologia, meno di dieci anni fa, il loro utilizzo si accompagna, sempre più spesso, alla commissione di reati di abusi e molestie nei confronti delle donne la cui immagine, come nella storia raccontata, viene stravolta e utilizzata per creare contenuti pornografici.

Secondo una analisi, pubblicata su Wired Uk, negli ultimi sette anni sono stati caricati almeno 244'625 video su 35 siti web creati per ospitare video porno deepfake. Nei primi mesi del 2023, i video caricati su questi portali sono stati 113 mila, con un aumento del 54 per cento rispetto ai 73 mila filmati aggiunti in tutto il 2022.

Secondo le stime di Wired, nel 2023 verrà caricato un numero complessivo di video ponografici deepfake superiore alla somma di tutti quelli caricati gli anni precedenti. Per creare un contenuto di natura pornografica la tecnologia utilizza degli algoritmi cosiddetti di 'deep learning', una sottocategoria del 'machine learning', impostati per rimpiazzare le immagini di donne caricate sul web con corpi nudi.

Another Body/Film Festival Diritti Umani LuganoTaylor Klein, vittima di deepfake, in una scena del documentario “Another Body”

Another Body/Film Festival Diritti Umani LuganoTaylor Klein, vittima di deepfake, in una scena del documentario “Another Body”L'algoritmo che spoglia

Come spiegato da Sophie Maddocks, esperta in abusi sessuali basati sulle immagini, in una intervista all'Università della Pennsylvania «questi algoritmi sarebbero in grado di 'spogliare' anche gli uomini, ma vengono generalmente addestrati su corpi femminili (…) le donne appartenenti a fasce più vulnerabili, come adolescenti o single, rischiano maggiormente di soffrire di abusi sessuali basati sulle immagini, così come le persone LGBTQ+ e i sex worker». La loro creazione, poi, è relativamente semplice, basta utilizzare uno dei tanti siti disponibili e chiunque può caricare contenuti pornografici aventi come protagonisti delle persone totalmente ignare di quanto sta avvenendo.

Se un tempo, infatti, per generare questi video era necessario essere in possesso di software e computer molto avanzati, adesso, come visto, esistono semplici app gratuite che è possibile utilizzare dal proprio smartphone. Nei mesi scorsi ha fatto scalpore la vicenda di Taylor Klein, nome di fantasia per proteggere la privacy, una studentessa statunitense di ingegneria che ha scoperto di essere protagonista, suo malgrado, di un video in cui faceva sesso con un uomo. Si trattava di un caso di deepfake e il volto della giovane era stato sovrapposto al corpo di un'altra donna.

«Ero semplicemente scioccata dal fatto che il mio nome e il mio volto fossero lì-racconta la giovane-e poi ho visto che questi video avevano migliaia di visualizzazioni». La vicenda di Taylor Klein è stata raccontata da Sophie Compton e Reuben Hamlyn in un documentario dal titolo 'Another Body', presentato fuori concorso al Film Festival dei Diritti Umani di Lugano, che esplora il lato oscuro del deepfake-porn che, secondo gli esperti, costituisce il 90 per cento di tutti i contenuti deepfake presenti online. La giovane ha scoperto quasi una decina di video pornografici di cui era protagonista su Pornhub, insieme a quelli legati a un account xHamster, corredati di commenti violenti e inquietanti.

«Continuavo a chiedermi perché qualcuno avesse voluto fare questo e chi lo avrebbe potuto fare. Mi sentivo come se qualcuno stesse cercando di punirmi» racconta la giovane nel documentario. Il fenomeno è così diffuso che sempre più nazioni al mondo si stanno attrezzando per mettere a punto delle norme che possano costituire una difesa legale efficace per le vittime.

Deposit

DepositLa legge all'inseguimento

Nel Regno Unito è stata approvata una legge che vieta la condivisione di deepfake a contenuto pornografico, ma non la sua creazione, mentre negli Stati Uniti solo lo Stato di New York, la Virginia, la Georgia e la California hanno delle norme inerenti questo problema anche se si sta valutando l'emanazione di una normativa a livello federale. Nel gennaio di quest'anno, la Cina ha emanato una normativa riguardante i deepfake, forse la prima a livello mondiale a regolamentare in maniera articolata tale tipo di tecnologia.

La normativa si riferisce, infatti, non solo la creazione di contenuti falsi ma di qualsiasi prodotto dell'Intelligenza Artificiale, rendendo illegali tutti i contenuti che abbiano “informazioni illegali o dannose o che si oppongono agli interessi nazionali”. In base a queste nuove disposizioni, i fornitori devono garantire, dal punto di vista tecnico e organizzativo, la sicurezza dei sistemi anche apponendo dei contrassegni che risultino ben visibili e riconoscibili sui contenuti creati con IA.

L'Unione europea, dal canto suo, ha incluso la regolamentazione del deepfake nell'Artificial Intelligence Act del 2021. In questo documento vengono elencati i sistemi di Intelligenza Artificiale da vietare perché in contrasto con i valori dell'Unione europea, e si stabiliscono i criteri in base ai quali definire i sistemi di IA come “ad alto rischio” in quanto lesivi della salute, della sicurezza o dei diritti fondamentali degli individui.

Come visto anche dalle storie precedentemente raccontate, il deepfake a contenuto pornografico ha un impatto devastante nelle vita di coloro che ne sono vittime e la maggior parte di loro parla di un vero e proprio “stupro sociale”. Come spiegato alla Bbc dalla professoressa Clare McGlynn, della Durham University, esperta di abusi sessuali basati sull'immagine, “molte vittime descrivono la propria vita come divisa tra un 'prima' ed un 'dopo l'abuso che colpisce ogni aspetto della loro vita, sia professionale, personale, sanitario ed economico”. La violenza contro le donne, compresa quella perpetrata online, è ancora troppo spesso minimizzata e banalizzata e, nei confronti del deepfake, si ha quasi la percezione che non implicando una violenza fisica vera e propria non sia, in fondo, così grave. La realtà dei fatti, invece, ci dice il contrario e sarebbe quanto mai necessario fermare un fenomeno che miete, ogni anno, sempre più vittime.

Deposit

Deposit Deposit

Deposit Another Body/Film Festival Diritti Umani LuganoTaylor Klein, vittima di deepfake, in una scena del documentario “Another Body”

Another Body/Film Festival Diritti Umani LuganoTaylor Klein, vittima di deepfake, in una scena del documentario “Another Body”